📜 강의 정리

* Coursera 강의 중 Andrew Ng 교수님의 Convolutional Neural Network 강의를 공부하고 정리한 내용입니다.

* 이미지 출처 : Deeplearning.AI

1. Case Studies

Why look at case studies?

I learned about

지난 시간에 conv layer, pooling layer, fc layer 에 대해 배웠는데, 어떻게 이것들을 쌓아야 효과적인 네트워크 아키텍쳐를 만들 수 있을까? 한 task에서 잘 작동하는 네트워크는 대부분 다른 task에도 잘 작동하기 때문에 이미 발표된 성능이 좋은 네트워크네 대한 리서치, 코드 등을 읽으면 좋다.

Classic networks(LeNet-5, AlexNet, VGG), ResNet, Inception 을 통해 어떻게 해야 effective convolutional network를 만들지에 대한 더 나은 intuition을 얻을 수 있다.

Classic Networks

✔ LeNet-5

- 네트워크가 깊어질수록(=왼쪽에서 오른쪽으로 갈수록) 채널수는 늘어나는 반면에 높이(n_h)와 폭(n_w)이 줄어드는 경향을 가진다.

- 한 layer에 conv layer, pooling alyer, 하나 이상의 conv layer, pooling layer, fc layer, fc layer, output이라는 패턴을 갖는다.

- 아래 이미지에서 빨간색으로 필기된 부분은 논문에서 제시되었던 부분이지만 현재에는 사용되지 않는 부분이다. 당시에는 ReLU가 아닌 sigmoid와 tanh 활성함수를 사용했고, pooling layer 후에 nonlinearity 함수(활성함수)를 적용하지 않았다. 과거의 computing 성능이 지금만큼 좋지 않았기 때문에 하드웨어적인 한계를 극복하기 위한 다양한 방식이 사용되었는데 지금은 사용되지 않으니 이 부분에 대해서는 자세하게 몰라도 된다.

✔ AlexNet

- 논문을 보면 224×224×3 의 input size를 갖는다고 하지만 실제로 들어맞는 크기는 227×227×3 이다.

- LeNet과 유사하지만 much bigger. LeNet은 약 6만개(60k)의 파라미터, AlexNet은 6천만개(60m)의 파라미터를 가진다.

- ReLU activation fuction 사용

- 2개의 GPU 사용

💥자주 헷갈리는 개념 정리 - 채널(Channel) vs 커널(Kernel) vs 필터(Filter)

우선 채널은 RGB, Grayscale 등에서 Red channel, Blue Channel, Green Channel 등에서 사용되는 단어이고, 채널의 개수가 input의 채널 개수와 같아야 한다.

커널과 필터는 같은 의미로 사용된다. 총 사용되는 필터의 개수가 output 채널의 개수가 된다.

indoml 에 잘 정리되어 있으니 이미지와 함께 보자!!

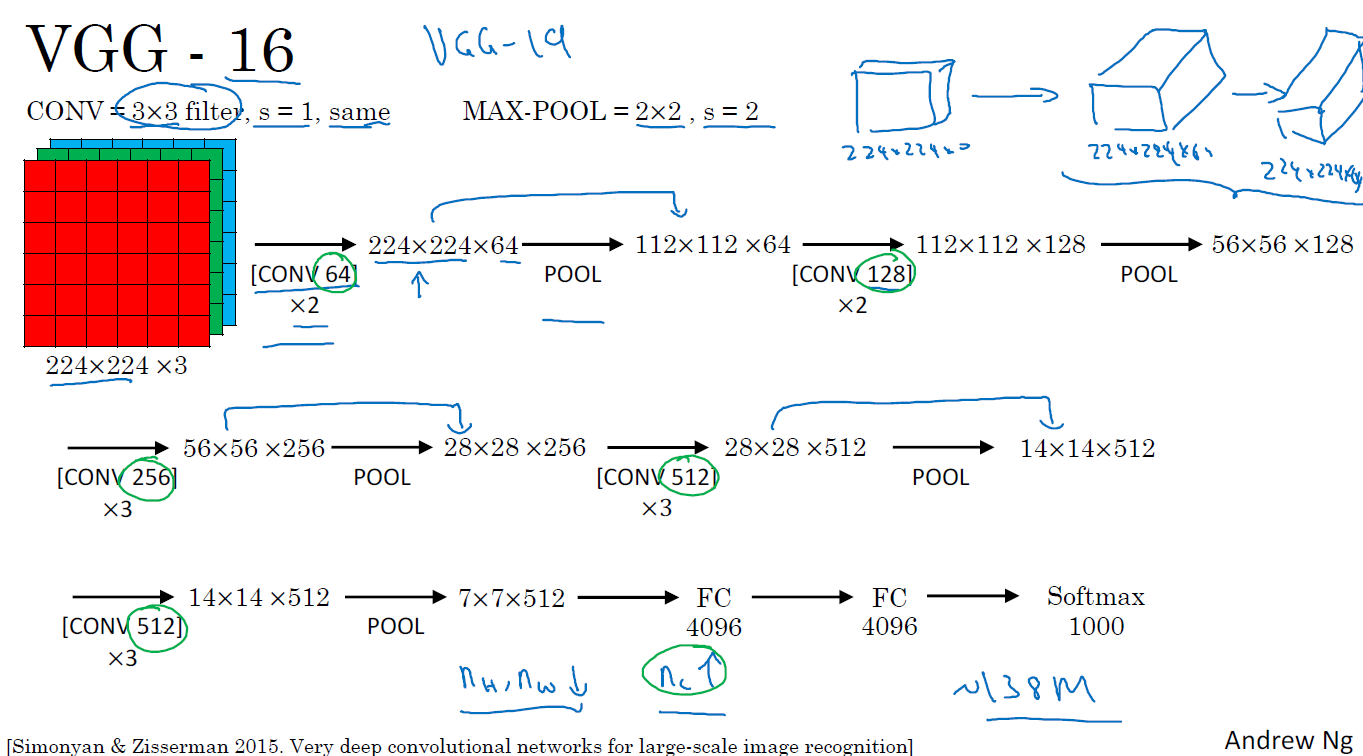

✔ VGG-16

- 많은 파라미터 가지고 있는 대신에 훨씬 단순한 구조. 항상 동일한 stride, padding, size의 Conv layer, Pooling layer 사용

- [CONV 64]×2의 의미는 conv layer를 2개 적용한다는 것.

- 약 1억 3천 8백만개의 파라미터

ResNet

매우 깊은 네트워크는 vanishing gradient와 exploding gradient 문제로 학습이 어렵다.

위의 과정을 전체적으로 표현하면 아래와 같이 2개의 layer마다 residual block이 생기는 것을 볼 수 있고 이것이 plain하게 layer를 쌓았을 때보다 효과적으로 학습이 진행됨을 볼 수 있다.

Networks in Networks and 1×1 Convolutions

Networks in Networks == 1×1 Convolutions

채널이 한 개일 때는 별로 효과적이어 보이지 않지만 여러개의 채널을 가지고 있을 때는 output 채널의 개수를 filter의 개수로 줄여주어서 계산해야하는 파라미터를 줄여주는 효과를 가지게 된다.

예시를 보면 다음과 같다. 28×28×192의 input 크기를 32개의 1×1 CONV 적용하여 28×28×32로 압축하였다.

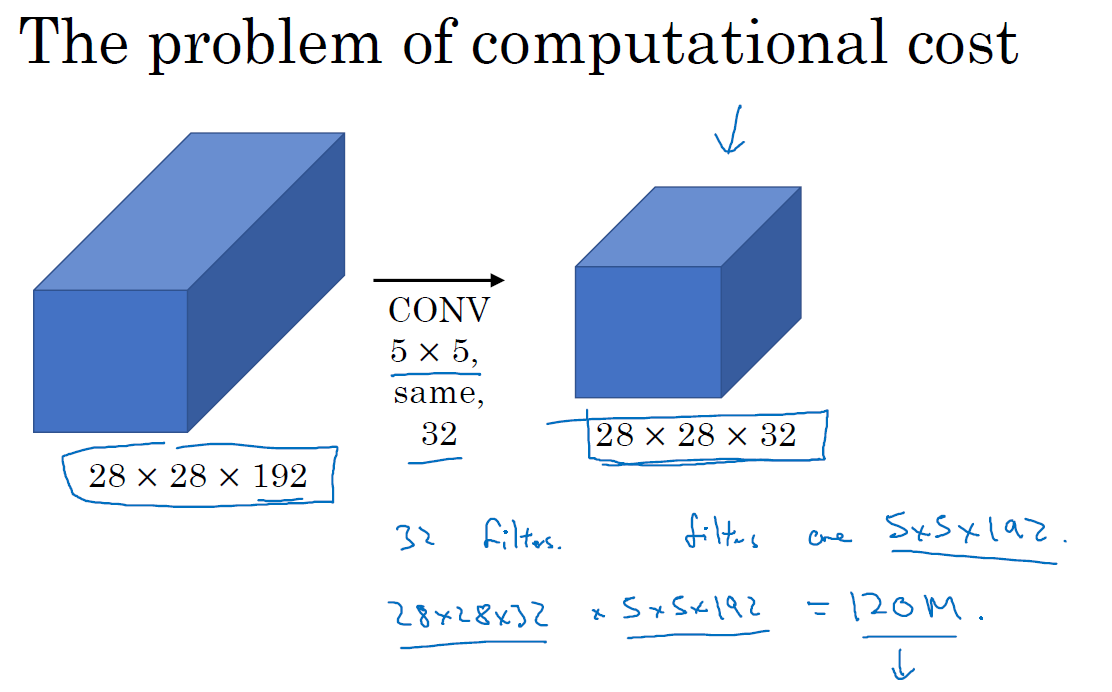

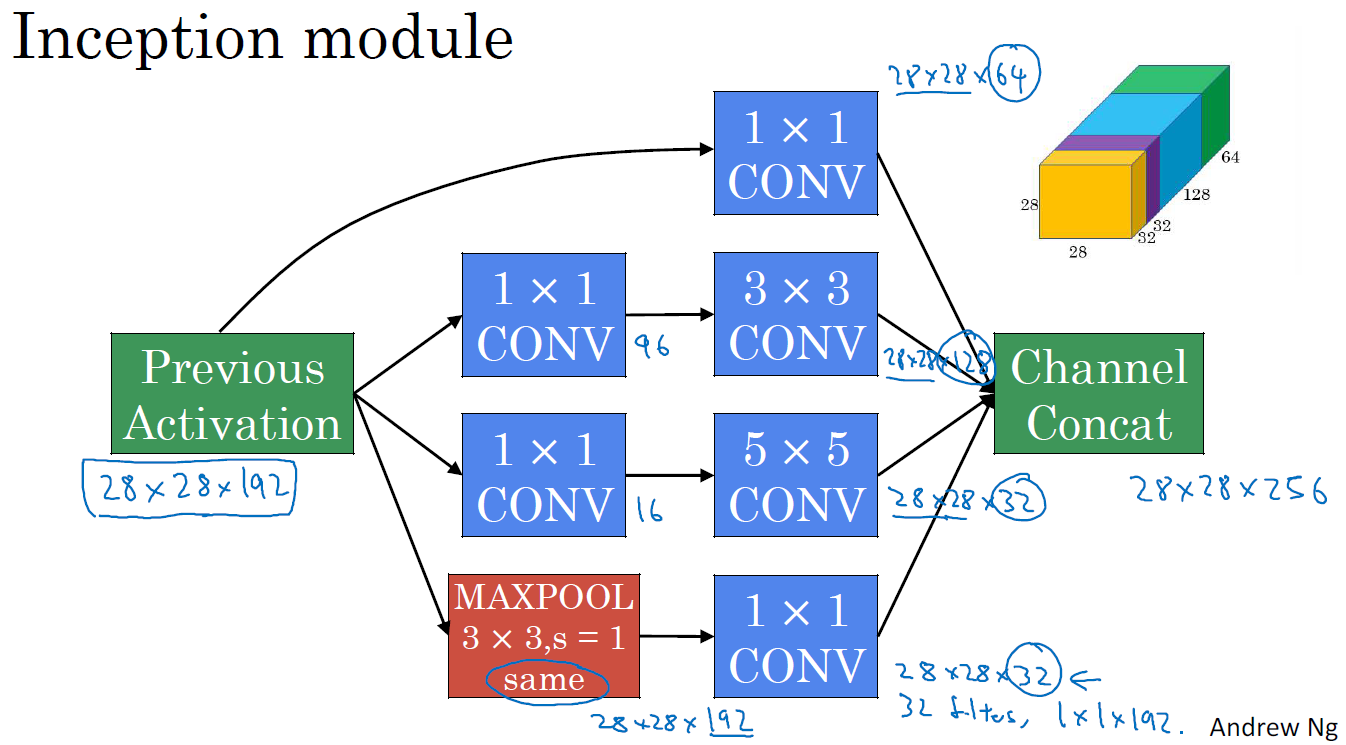

Inception Network Motivation

motivation : 뭘 원하는지 몰라서 다 준비했어

1×1 filter, 3×3 filter, pooling layer, 5×5 filter 등 무엇을 사용할지 고민하지말고 output size의 크기만 고려해서 모두 학습한다.

문제는 계산비용인데, 위의 예시에서 5×5 Conv layer에 초점을 맞추어서 보자

filter size가 5×5×192 임을 계산할 수 있고 전체 계산해야하는 개수는 filter의 파라미터에 output 파라미터의 개수를 곱한 값이다. 따라서 5×5×192 * 28×28×32 = 약 1억 2천만 개의 연산이 필요하다

1×1 convolution을 통해 이를 1000분의 1로 줄일 수 있다.

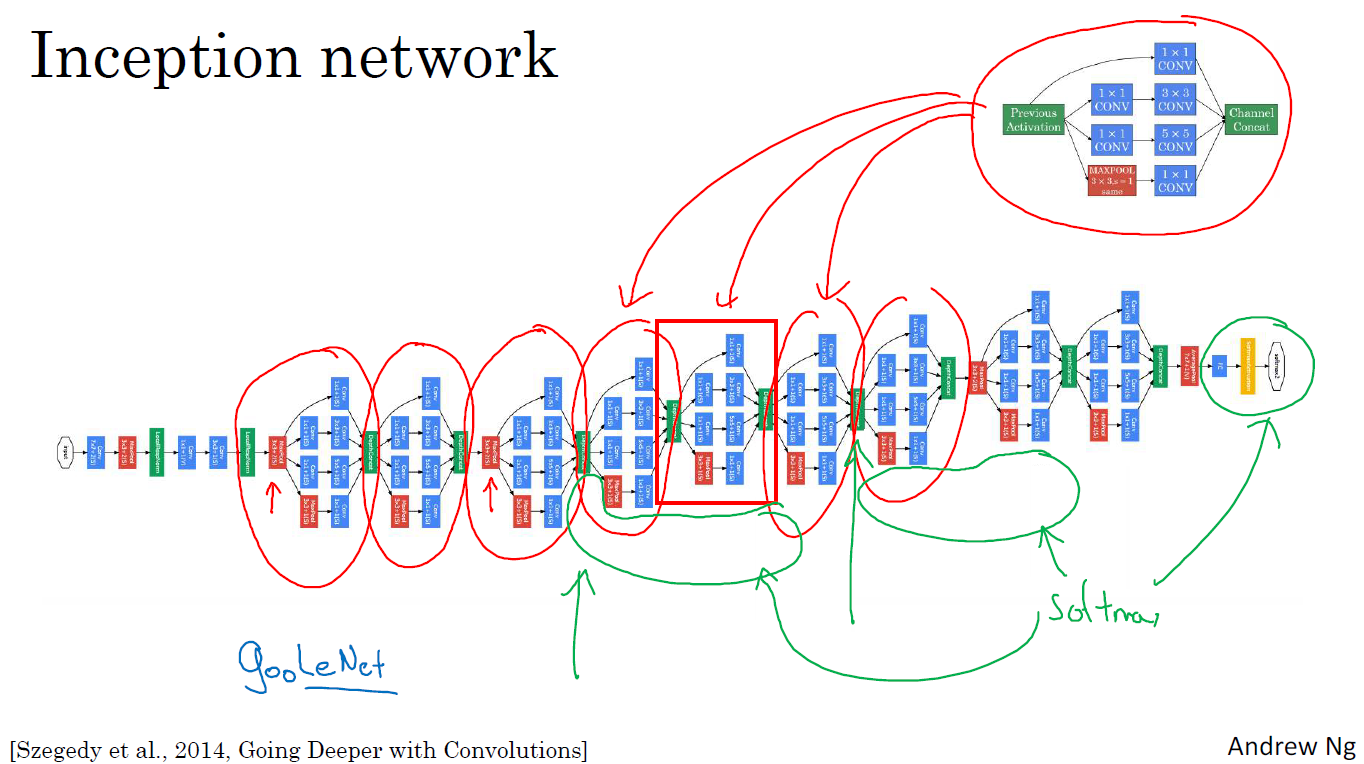

Inception Network

GoogLeNet으로 불리기도 한다.

MobileNet

젯슨나노에서 YOLO는 너무 느려서 사용하지 못하고 MobileNet은 적당한 FPS가 나와서 사용했던 경험이 있었는데, 어떻게 하면 낮은 성능의 컴퓨팅 파워에서도 문제 없이 돌아가는지 궁금했는데 이번 강의를 통해 궁금증이 해결되었다.

바로 Depth-wise separable convolutions 라는 방식이다. 비교를 위해 normal한 computational cost를 구해보자.

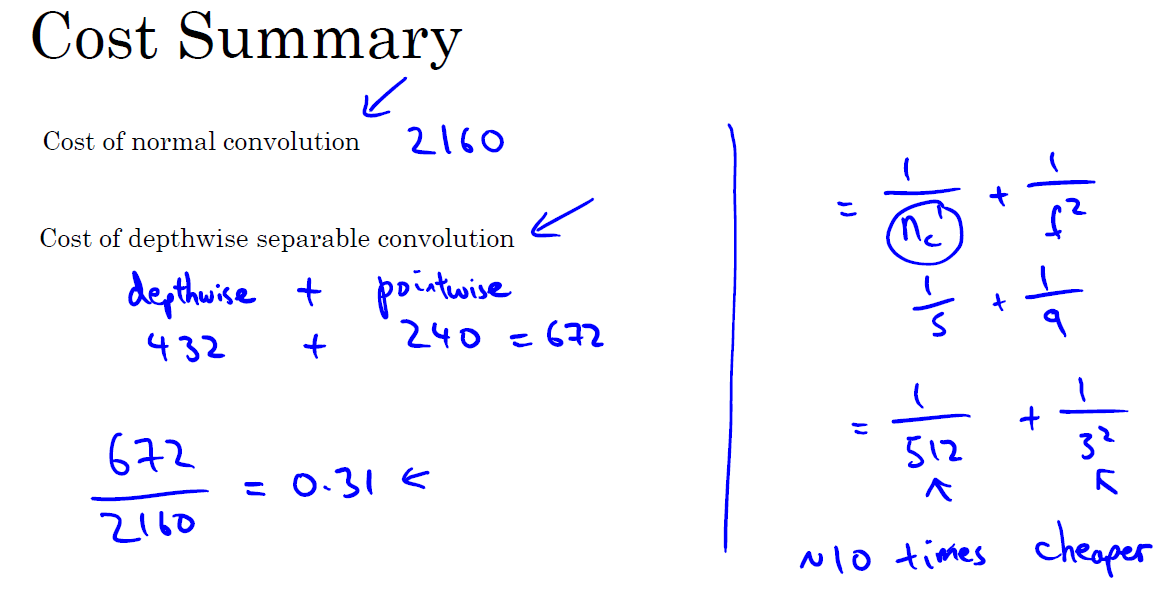

input size가 6×6×3 이고 5개의 3×3×3 filter로 conv 연산을 했다고 하면, Computational cost는 filter의 파라미터 개수와 output의 파라미터 개수의 곱이므로 3×3×3 * 4×4×5 = 2160이다.

이를 depthwise를 적용하면 Depthwise Convolution과 Pointwise Convolution 부분으로 나누어서 계산할 수 있다.

Depthwise convolution은 다음과 같이 총 filter의 개수는 생각하지 않고 filter의 채널과 input의 채널을 각자 계산을 하는 것이다. 그렇게 하면 Computational cost에서 filter와 output의 채널 수에 대한 곱이 빠지게 된다. 따라서 한 채널에 해당하는 filter의 파라미터에 output 파라미터를 곱하고 채널의 수를 곱해주면 된다. 3×3 * 4×4 * 3 = 432 개가 나온다.

이제 pointwise convolution을 통해 nomal 방식과 output의 shape을 맞춰준다. Computational cost를 계산해보면 filter의 파라미터 * output 파라미터이므로, 1×1×3 * 4×4×5 = 240 이다.

앞서 봤던 일반적인 계산 방식에서는 2160개의 연산이 필요했는데, depthwise separable 방식을 사용하면 432 + 240 = 672의 연산이 필요한 것을 알 수 있다. 이는 2160의 0.3에 해당하는 숫자이다.

일반적으로 그 수치는 1/(output 채널의 개수) + 1/(filter size의 제곱) 로 예상할 수 있다.

MobileNet Architecture

MobileNet v1과 v2의 차이점

- v1은 depthwise separable convolution이 13번 반복, v2는 17번 반복

- v2는 v1에서 residual connection(=skip connection) 적용

- Expansion layer 추가

MobileNet v2 의 bottleneck 부분을 자세히 보면 다음과 같다.

EfficientNet

네트워크에서 조절할 수 있는 요소로는 Resolution, Depth, Width 등이 있는데 어떤 크기로 어떻게 조합해야 좋은 선택일까?

EfficientNet을 통해 디바이스에 적합한 R, D, W의 조합을 찾을 수 있다.

Tips for doing well on winning competitions

Ensemble과 Multi-crop at test time 방법이 있지만 실제 product에 적용하기는 메모리, 시간적인 문제가 있고 대회용으로 사용

댓글